2024年自动驾驶行业专题报告:智驾发展方向确立,激发配套软硬件需求(附下载)

(精选报告来源:报告研究所)

1 特斯拉:全球自动驾驶领域领先企业,FSD V12 开创 端到端 AI 自动驾驶系统先河

1.1. 发展过程:第一性原理贯穿发展历程,自动驾驶系统持续迭 代升级

特斯拉自动驾驶发展持续强调“第一性原理”,聚焦发展纯视觉自动驾驶。第一性原理是指回归事物最基本的条件,从问题最核心的部分开始推理,从 而找到解决问题的最佳方案。特斯拉认为唯一能出色完成驾驶任务的是人脑, 同时人类在驾驶时接受到的绝大部分信息来自视觉。因此,根据第一性原理, 马斯克认为解决自动驾驶的问题本质上是打造模仿人脑工作的自动驾驶系 统,不断发展纯视觉的感知路线,使算法运行更趋向于理解真实世界。特斯拉自动驾驶系统历经四阶段重要迭代,自主研发能力持续提升。早期特 斯拉自动驾驶系统由外部供应商 Mobileye 提供,2016 年双方终止合作后, 特斯拉开始展开全栈自动驾驶算法自研,2020 年重构算法后,逐渐确立行 业领头羊位置。特斯拉自动驾驶算法及硬件主要经历了以下四个个阶段的迭 代发展:

第一阶段(2016 年前):自动驾驶自研尚未成型,依靠 Mobileye 公司技术 发布第一代自动驾驶系统。2014 年 10 月,特斯拉发布第一代 Autopilot,搭 载硬件 Hardware 1.0,自动驾驶系统软硬件均由 Mobileye 公司提供。2015 年,特斯拉开始布局自研自动驾驶软硬件,创建软件算法小组 Vision。Mobileye 采用全封闭的"黑盒"策略来提供其软硬件系统,灵活度较低,难以 跟上特斯拉产品发展步伐,合作模式存在潜在弊端。2016 年 5 月,一辆在 Autopilot 状态下的 Model S 意外撞上垂直方向驶来的白色挂车,导致一人死 亡。2016 年 7 月,在事故的间接影响下,特斯拉与 Mobileye 终止合作,开 启自研之路。

第四阶段(2020 年-2021 年):特斯拉自动驾驶系统完成重构,引入 BEV+Transformer 核心架构、特征级多传感器融合、数据自动标注等多个 众多自动驾驶方案提供商至今仍在使用的核心技术,特斯拉登上自动驾驶 行业龙头位置。

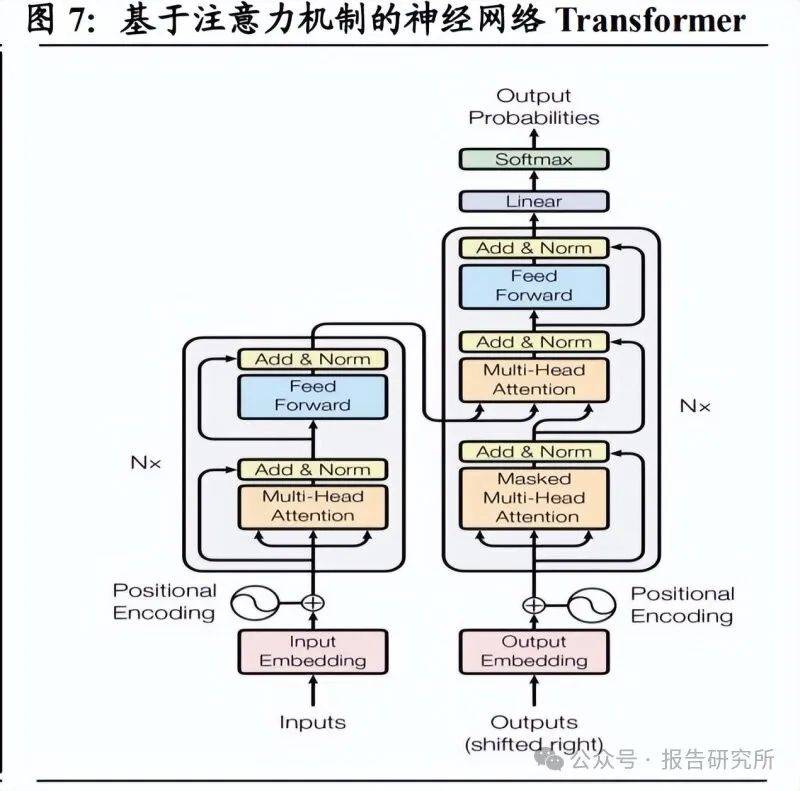

1)BEV+Transformer 核心架构:过去自动驾驶系统主要依靠摄像头采集到 的 2D 图像数据,难以完美记录真实的三维世界信息。特斯拉引入 BEV 鸟 瞰图视角,将不同视角的图像信息统一成一个鸟瞰俯视图,有利于后续自动 驾驶规划控制模块任务;同时,BEV 视角有效解决了图像视角下的尺度和 遮挡问题。为实现 BEV 视角,特斯拉特斯拉引入大模型 Transformer,进行 3D 到 2D 的逆向开发。其中 Transformer 是一种基于注意力机制(Attention) 的神经网络模型,与传统的神经网络如 RNN 和 CNN 不同,Transformer 是 通过注意力机制来探索序列中不同元素间的相关性,使得 Transformer 可以 适应不同长度和不同结构的输入数据。特斯拉先在 BEV 空间层中初始化特 征,再通过多层的 Transformer 和 2D 图像特征进行交互融合,最终得到 BEV 特征。

2)特征级多传感器融合技术:自动驾驶系统依靠多个传感器对周围世界进 行感知,多传感器融合利用不同的传感器的优势弥补其他传感器的弱势,从 而实现对现实世界更准确的感知。为改善后融合策略易产生的信息失真劣势, 特斯拉引入特征级融合,先从每个传感器提供的原始观测数据中提取代表性 的特征,再对这些特征进行融合,得到总的特征向量,可以更好地保留传感 器收集到的原始数据,从而为后续规划提供支持。

3)数据自动标注技术:过去特斯拉采用自建的人工标注团队进行数据标注, 由于自动驾驶数据不断扩大,所需标注人员数量也进一步增长,导致了成本 不断攀升。为解决人工标注高成本低效率的弊端,特斯拉引入了数据自动标 注系统。车辆采集数据以 Clip 作为最小标注单元,一个 Clip 中包含视频、 惯性测量单元(IMU)、GPS、里程计(odometry)等其他数据。在车辆行驶 过程中,摄像头对路面信息进行采集,打包上传到服务器的离线神经网络大 模型,由大模型进行预测性标注,再反馈给车端各个传感器。由于传感器视角不同,当预测的标注结果在特斯拉使用的 8 个传感器均呈现一致时,则这 一标注成功。针对训练自动标注 AI,特斯拉会从自身的工程车(Engineering Cars)和客户车(Customer Cars)中获取 Clip 数据,使用手动标记来训练校 准自动标记人工智能神经网络。

1.2. 特斯拉自动驾驶进展:算法持续优化+配套设施升级,形成完 善算法训练体系

特斯拉不断优化自动驾驶算法自身,同时注重配套设施升级。特斯拉在 2022 年 AI Day 中公布其自动驾驶最新进展,自动算法方面,首次公布了特斯拉 在感知、决策规划、矢量地图方面的进展;配套设施方面,特斯拉介绍了其 用于自动驾驶算法训练的模拟仿真技术与自建的超算中心。自动驾驶算法优 化及配套设施升级两大方面齐头并进,为特斯拉自动驾驶算法持续发展迭代 提供了保障。

感知:引入 Occupancy Network 概念,进一步升级 BEV 体系

决策规划:引入 Interactive Planning 概念,高效应对复杂的自动驾驶情景

传统轨迹搜索型路径规划耗时较长,难以应对复杂交通环境。特斯拉 2022 年 AI Day 分享了自动驾驶系统可能遇到的较为复杂的交通情景:拥堵十字 路口,前方道路有行人横穿和行车占道通行的情况下,车辆要求进行无保护 左转。传统自动驾驶系统会基于各个轨迹的成本以及约束进行路径规划,让 本车以及其他交通参与者的运动轨迹进行交互,对当前场景下所有交通参与 者进行运动轨迹预测,运算过程大概耗时 10ms。但是在上述描述的拥堵路 口情境下,会有超过 20 个交互相关的交通参与者,有超过 100 种交互相关 组合。传统的基于轨迹搜索的路径规划算法存在搜索空间过大,耗时较长的 弊端,难以应对复杂环境。

矢量地图:引入 Lanes Neural Network,预测车道拓扑连接关系高效进行轨 迹规划

三大板块构建高精度矢量地图,助力高效轨迹规划。Lane Network 主要由 三个算法模块构成。1)视觉模块(Vision Component):采取前文介绍过的 BEV+Transformer+Occupancy Network 架构,生成三维地图信息供后两模块 构造矢量地图;2)地图模块(Map Component):使用导航地图中的几何 及拓扑关系,车道等级、数量、宽度、属性信息,将这些信息与 Occupancy Network 数据进行整合,生成 Dense World Tensor,随后作为输入传入拓扑关系建立模块,将视频流稠密的特征解析出稀疏的道路拓扑信 息;3)地图语言模块(Language Component):把车道相关信息包括车道 节点位置、属性(起点,中间点,终点等)、分叉点、汇合点,以及车道样 条曲线几何参数进行编码,生成类似语言模型中单词 token 的编码,然后 利用时序处理办法进行处理。最后生成如下图所示的稀疏的全局道路拓扑 信息,仅包含蓝色的车道中心线和一些白色的关键节点(连接点 connection,分叉点 fork,并道点 merge),并通过图的形式来展现节点之间 的连接关系。

仿真:创造自动驾驶场景,保障自动驾驶算法测试

仿真环境为自动驾驶测试关键一环。自动驾驶仿真是将真实路段的信息通过 场景建模或数字孪生的方式在虚拟环境里实现,在此基础上生成各式各样的 交通流,产生大量的混合式仿真数据以及自动生成的标注真值,提供给自动 驾驶模型进行训练和测试,提高模型的泛化性。据统计,自动驾驶测试中有 90%的场景通过仿真平台来完成,仿真测试为检测自动驾驶模型的关键一环。

特斯拉 Simulation World Creator,高效构建自动驾驶仿真虚拟环境。在掌 握大量自动标注的真实世界道路信息,和丰富的图形素材库后,特斯拉采取 以下五个步骤完成对虚拟仿真测试环境的构建。1)路面生成:根据路沿进 行路面的填充,包括路面坡度、材料等细节信息;2)车道线生成:将车道 线信息在路面上进行绘制;3)植物和楼房生成:在路间和路旁随机生成和 渲染植物和房屋,仿真真实世界中物体引起的遮挡效应;4)其他道路元素 生成:如信号灯,路牌,并导入车道和连接关系;5)加入车辆和行人等动 态元素。对于一个复杂的路口,利用传统建模渲染的方案需要设计师 2 周的 时间。作为自动驾驶仿真方面的领头羊,特斯拉通过 AI 化的方案,只需要 5 分钟即可完成该场景的构建。

数据:加速建造自研超算中心,高效处理自动驾驶数据流

Dojo 超算正式投产,强大算力为自动驾驶训练保驾护航。自动驾驶算法的演进需要对海量数据进行分析及不同方案的神经网络进行测试,强大的算力 是算法研发效率的重要保障。Dojo 架构方面,当车辆捕获视觉数据时,Dojo 能够将图像数据逐帧转换为 3D 视频动画。这使得神经网络能够拥有完整的 数据序列,包括向前和向后查看不同动画帧的能力,使 Dojo 能够对神经网 络进行自我监督训练。例如,神经网络可以在视觉数据的第一帧中进行预测, 然后在第 20 帧中自检其预测。这个过程可以在所有收集的视觉数据中重复 多次,从而显著提高学习速度;Dojo 算力方面,在特斯拉 AI Day 2022 公布 的数据中,与英伟达的 A100 相比,一颗 D1 芯片在配合特斯拉自研编译器 的情况下,在自动标注任务中最高能够实现 3.2 倍的计算性能,在占用网络 任务中最高能够实现 4.4 倍的计算性能。

1.3. FSD 最新进展:2025 年有望逐步落地

2024 年,特斯拉再度推动自动驾驶技术进入新阶段,推出了 FSD V12 版本。这一版本的发布标志着特斯拉自动驾驶从传统的模块化功能迈向了“端到端” 一体化的系统管理。现在,自动驾驶的每一个步骤——从环境感知、决策制 定到车辆操控——都由一个高度集成的网络系统协调完成,使得整体的安全 性和可靠性有了显著提升。这次技术升级不仅展示了特斯拉在自动驾驶领域的持续创新能力,更为未来 智能交通的可能性拓宽了路径。从 2016 年起步探索到 2024 年的全面升级, 特斯拉 FSD 的进化过程记录了自动驾驶技术从构想到实践的关键历程。特 斯拉的努力不仅推动了自身技术的成熟发展,还带动了整个汽车行业向更智 能、安全和便捷的出行方式不断迈进。

FSD V12 采用的是端到端的大模型技术,改变传统的自动驾驶系统架构。从技术方面来看,特斯拉 FSD V12 版本采用的是端到端的大模型技术,一 端输入环境图像的像素点,在通过神经网络大模型后,在另一端直接输出控 制指令。用马斯克直播中的话说就是“光子进,行为出”,几乎接近人类驾 驶的思维方式。现在的 FSD Beta V11.4.4 版本,在控制栈中有超过 30 万行 C++代码,主要决策逻辑仍然是基于代码描述的规则进行逻辑判断,而特斯 拉 FSD V12 系统内部没有任何条件判断代码,其处理复杂交通环境的能力 来自于大量的数据训练,使其形成了类似人类驾驶的一样的记忆与习惯。从 硬件方面来看,特斯拉 FSD V12 采用 8 个摄像头,以每秒 36 帧的速度进行 拍摄,系统的计算速度可以达到每秒 50 帧,而实际路况只需要每秒 24 帧便 可以正常运行 FSD V12。目前无论是摄像头帧率还是系统计算速度,在实际 运行过程中都是足以应对各种路况的。另外,马斯克在直播提到,特斯拉 FSD V12 可以离线运行。如果行驶过程中有人工干预行为发生,系统会将其记录 并上传至云系统进行分析。

2. 小鹏:国内高级智驾龙头企业,加速轻地图 XNGP 研 发

2.1. 智驾系统:推出最新一代 XNGP,可实现全场景智能辅助驾 驶功能

声明: 本文由入驻搜狐公众平台的作者撰写,除搜狐官方账号外,观点仅代表作者本人,不代表搜狐立场。

回首页看更多汽车资讯

大白兔

0大白兔 小子

0